După atentatul sângeros din orașul Christchurch au apărut foarte multe voci care au criticat Facebook pentru că a permis transmiterea live a atentatului.

Cum explică Facebook faptul că sistemele de inteligență artificială (AI - artificial intelligence) nu au detectat live streamingul atentatorului din Christchurch.

Deși s-au înregistrat progrese în tehnologia inteligenței artificiale în ultimii ani, compania a recunoscut că există totuși sincope și scăpări.

"Nu e un sistem perfect", a declarat Facebook într-un comunicat. "Sistemele AI se bazează pe "date de comparare", ceea ce înseamnă că ai nevoie de multe mii de exemple de conținut pentru a instrui un sistem ca să detecteze anumite tipuri de text, imagini sau video", se apără oficialii Facebook, citați de Newshub.co.nz.

Gigantul social-media a explicat că, în timp ce sistemele AI sunt eficiente în detectarea conținutului de nuditate, propagandă teroristă sau violență grafică, sistemele lor nu au putut identifica și bloca videoclipul de vineri în care teroristul australian a mitraliat live zeci de oameni în moscheea din Noua Zeelandă.

"Pentru a realiza acest lucru, ar trebui să furnizăm sistemelor noastre volume mari de date cu un conținut similar, ceea ce este dificil deoarece astfel de evenimente sunt rare, din fericire".

Armele semiautomate, interzise în Noua Zeelandă după atentat

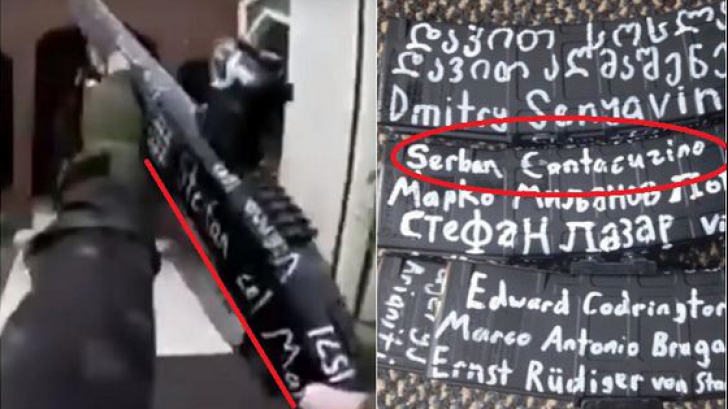

Vineri, 50 de credincioşi musulmani au fost ucişi la ora rugăciunii la Christchurch, în Insula de Sud, de un adept al supremaţiei albilor care a difuzat în direct imagini ale atacului său şi a publicat în prealabil un "manifest" rasist.

Premierul Noii Zeelande, Jacinda Ardern, a promis marţi să nu pronunţe niciodată numele autorului atacului terorist criminal împotriva a două moschei şi a anunţat neozeelandezilor că acesta va intra sub incidenţa celei mai stricte legi.

"Prin acest act terorist, el a căutat multe lucruri, iar unul dintre acestea era notorietatea. Din acest motiv nu mă veţi auzi niciodată pronunţându-i numele", a spus premierul.